Diagnóstico do preconceito: o problema das IAs na medicina

Publicado em 09 de outubro de 2025

Conversa boa, hein? A resposta curta é depende. Mas tem muita gente estudando isso:

Imagina comigo, você tem um artigo para entregar amanhã. Ou melhor: hoje. São duas da manhã, e o prazo é às nove. O café esfria sobre a mesa, o documento no Word parece mais ruído que argumento, e o cursor pisca como se zombasse do seu esgotamento. Você já não sabe se está pensando ou apenas tentando parecer alguém que pensa, e já começa a ter pena de si mesmo enquanto negocia consigo situações hipotéticas que jamais irão acontecer, como "tá, mas e se o mundo acabar?".

Aí então, faz o que milhares de pessoas têm feito em silêncio, com certo constrangimento, e cada vez mais frequência. Você abre o ChatGPT.

Cola o texto, digita um pedido curto: “deixa mais fluido, revisa os erros, confere os fatos, formata as referências”. Em minutos, o caos vira coerência. O texto está mais leve, mais lógico, mais... legível! Até a bibliografia (aquela tortura de última hora da ABNT) aparece organizada no formato certo, com aspas e vírgulas nos devidos lugares. Você salva o arquivo, sente um alívio quase físico e orgásmico. Mas a pergunta que começa a se instalar é de outra ordem: isso foi ajuda ou foi trapaça?

A dúvida é legítima. E, segundo Cheng, Calhoun e Reedy (2025), é também o novo ponto cego da integridade acadêmica. Em seu estudo publicado na Advances in Simulation, os autores descrevem uma tensão que define o momento: pesquisadores e estudantes estão presos entre o desejo de eficiência e o medo de perder o próprio ofício. Eles chamam isso de zona cinzenta ética da autoria assistida.

O ponto de partida é simples, quase banal: nunca tivemos tantas ferramentas capazes de escrever por nós. Só que a fronteira entre usar e ser usado por elas se tornou cada vez mais difícil de traçar. Historicamente, o uso de tecnologia na academia sempre foi uma questão de extensão, não de substituição. Programas estatísticos, gerenciadores de referência, tradutores automáticos, tudo isso foi aceito porque tornava mais ágil o que já era um gesto humano. Ninguém considerava fraude usar o SPSS para uma análise de variância, ou o Zotero para organizar citações. Mas os LLMs "Large Language Models" mudam o jogo.

Eles não apenas corrigem. Eles produzem.

E é aí que começa o dilema.

Como escrevem Cheng e colegas, os modelos de linguagem “geram texto original a partir de padrões estatísticos de probabilidade linguística, não de entendimento semântico real”. Em outras palavras, o que parece pensamento é predição estatística (e eu não vou nem entrar no mérito se o pensamento também não o seria). O resultado é persuasivo o suficiente para passar por verdadeiro, e isso é, paradoxalmente, o problema.

A questão, portanto, não é se usar um LLM constitui fraude, mas quando seu uso passa de assistência a abdicação.

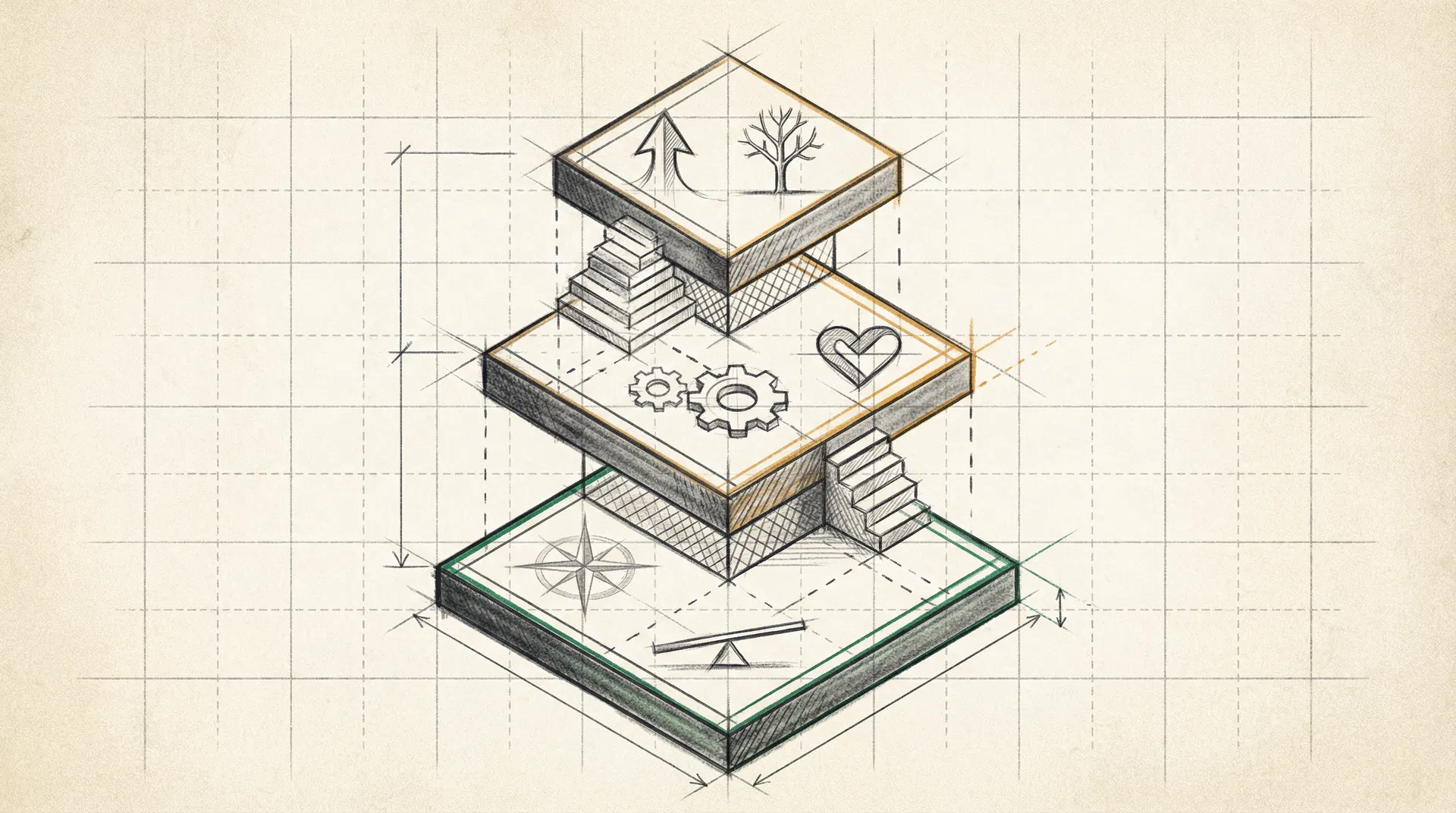

No estudo, Cheng, Calhoun e Reedy propõem um mapa conceitual para navegar esse território: uma estrutura ética de três níveis. É menos um código de conduta e mais uma lente de discernimento.

O Nível 1 abrange usos eticamente aceitáveis: revisão gramatical, checagem de estilo, clareza de linguagem, tradução preliminar. Aqui, a IA é espelho — refina o texto, não o pensamento. O risco é baixo, desde que o autor mantenha controle sobre o sentido e preserve sua própria voz.

O Nível 2 representa o terreno instável das ambivalências: quando o modelo é usado para resumir textos, estruturar um argumento, gerar um esboço ou reorganizar ideias. São tarefas que podem ajudar a pensar melhor — ou substituir o próprio ato de pensar. A diferença está na intensidade da intervenção humana. Se o autor supervisiona, revisa e reescreve, o uso continua ético. Se ele apenas aceita o resultado, a autoria já começou a escapar.

O Nível 3, enfim, é o território perigoso. Trata-se dos usos em que o LLM substitui o engajamento intelectual essencial: quando o autor pede que a máquina gere texto novo, interprete dados, realize análises primárias ou construa revisões bibliográficas completas. Essas tarefas, dizem os autores, “representam abdicação do trabalho cognitivo central à pesquisa”. É o momento em que o pesquisador troca o processo por produtividade.

Cheng e colegas alertam: esse tipo de delegação não é apenas questão de má conduta, é erosão de competência. Quando você deixa de interpretar seus próprios dados ou de verificar suas próprias fontes, o que se perde não é só o controle sobre o texto, é a própria capacidade de compreender o que se está escrevendo.

O estudo também propõe uma ferramenta prática: uma lista de quatro perguntas para o uso responsável de IA na escrita acadêmica. Não são regras morais, mas espelhos cognitivos, perguntas para fazer a si mesmo antes de apertar “enviar”. “Eu usei IA de modo a garantir que as ideias centrais e interpretações são minhas?” “Eu preservei minhas competências humanas de escrita e análise?” “Eu verifiquei a precisão e a confiabilidade de tudo que foi gerado?” “E, finalmente, eu divulguei claramente como e onde a IA foi usada?”

A quarta pergunta é, para os autores, inegociável. Transparência, escrevem, “não é opcional”. Não basta reconhecer a ajuda da IA em agradecimentos genéricos, é preciso documentar o processo metodológico: qual modelo foi usado, em quais etapas, com quais revisões humanas. A omissão, por descuido ou conveniência, compromete a integridade do trabalho.

Eles sugerem até um modelo de registro auditável, inspirado nos cadernos de laboratório da ciência experimental: anotar prompts, saídas, revisões e decisões, criando uma trilha visível do diálogo entre humano e máquina. Essa ideia é simples, mas radical: devolver à autoria sua dimensão de responsabilidade, não de origem.

Um ponto fundamental sobre o método científico que é os resultados sempre serão os mesmo, quando realizados os mesmos processos, e é isso que deve garantir a eficiência probatória da ciência. No entanto, quando utilizo os mesmos prompts em mesmas IAs, ainda assim obtenho resultados diversos. Esse é o principal fator descredibilizador atual: se houvesse consistência, poderia haver ciência.

Em seu cerne, o artigo de Cheng, Calhoun e Reedy não é sobre tecnologia, é sobre o que significa ser autor, pesquisador ou cientista. E aqui o dilema das duas da manhã se transforma em metáfora de algo maior. Porque, quando a pressa e o cansaço nos empurram para a conveniência da automação, o que está em jogo não é apenas um texto. É a relação entre pensamento e tempo.

A escrita acadêmica, com toda a sua lentidão e rigor, é uma forma de treino cognitivo que obedece (e deve obedecer) a métodos, processos e ritos que caracterizam a própria natureza e eficácia da ciência. É o espaço em que a mente se dobra sobre si mesma, experimenta, testa, falha. Ao terceirizar etapas fundamentais, verificação, citação, estrutura, corremos o risco de enfraquecer o próprio músculo que sustenta o pensamento crítico e os resultados científicos.

Além disso, os autores do estudo chamam isso de “atrofia de habilidades essenciais”. E têm razão: o aprendizado não acontece só no produto final, mas no atrito do processo.

O perigo maior então, não é o erro da máquina, é o entorpecimento do humano. E esse risco já começa a ser medido empiricamente.

Pesquisas como a de Nataliya Kosmyna e colegas no MIT Media Lab (2025), Your Brain on ChatGPT, mostram que o uso de assistentes de escrita baseados em IA reduz a conectividade neural e o engajamento cognitivo durante tarefas de redação. Em outras palavras: quanto mais a máquina escreve por você, menos o seu cérebro participa. A promessa de produtividade esconde uma dívida invisível, "cognitiva”, como chamam os pesquisadores (que se acumulam com o tempo).

Outros estudos, como o de Dhillon et al. (2024), indicam que altos níveis de assistência textual reduzem a sensação de controle autoral e, paradoxalmente, diminuem a qualidade do raciocínio. A IA ajuda o texto a fluir, mas pode enfraquecer o vínculo entre o autor e o argumento.

Essas descobertas reforçam o alerta de Cheng e colegas: o desafio não é proibir o uso de IA, mas delimitar o quanto do humano precisa permanecer no centro do processo. Porque, no fim das contas, o verdadeiro risco não é ético, é epistemológico.

E é curioso: a conclusão do paper, escrita em tom quase pedagógico, ressoa como um lembrete de humanidade. Eles afirmam que, por mais sofisticada que seja a tecnologia, a responsabilidade pelo conteúdo, pela precisão e pela originalidade de um texto é intransferivelmente humana. O autor é quem responde, e só ele. A IA pode ajudar a escrever, mas não pode assumir culpa. E sem culpa, não há ética.

Aliás, essa frase — “sem culpa, não há ética” — não está no artigo, mas poderia estar. Porque é disso que se trata. No fim, o que define o limite entre autoria e automação não é o quanto usamos tecnologia, mas o quanto ainda nos reconhecemos no que produzimos.

Quando você aperta “gerar texto”, a IA não está roubando nada de você. Ela só está ocupando o espaço que você cedeu.

E às duas da manhã, com o prazo se aproximando e a lucidez escapando, talvez esse seja o teste mais honesto da era digital: não o que a máquina é capaz de fazer, mas o quanto você ainda quer ser capaz de pensar.